「業務を自動化したいけれど、顧客データを扱うのが怖い……」

その感覚は正しいです。しかし、リスクを恐れて効率化を諦める必要はありません。

重要なのは、データがどう流れるかを知り、適切な対策をすること。

この記事では、APIキーの安全な管理法から、ログの制御、法規制のポイントまで、非エンジニアの実務担当者が自分で実行できるデータ保護対策を解説。

今日から使えるチェックリストで、あなたの自動化を堅牢にしましょう。

ワークフロー自動化でデータ保護が必要になる理由

ワークフロー自動化は業務効率を大きく向上させる手段ですが、その仕組み上、データを複数の外部サービスに預けることが前提になっています。データ保護を意識せずにワークフローを構築すると、意図しない情報漏洩に直結するリスクがあります。便利さの裏にある構造的なリスクを理解することが、安全なワークフロー自動化の第一歩です。

業務効率化の裏側にあるデータ流出リスク

たとえば、お問い合わせフォームに入力された顧客情報をスプレッドシートに自動記録し、その内容をSlackの担当チャンネルに自動通知するワークフローを考えてみてください。これは多くの企業が実際に導入している、ごく一般的な自動化です。

しかし、このワークフローでは顧客の氏名やメールアドレス、問い合わせ内容が、フォームサービス、ワークフローツール、スプレッドシート、Slackという少なくとも4つのサービスを経由しています。それぞれのサービスが独自のサーバーにデータを保存し、独自のセキュリティポリシーで運用されています。

このとき、顧客データがどのサーバーを通っているか、どこに保存されているか、いつ削除されるかを把握できていない方がほとんどではないでしょうか。ワークフロー自動化は設定が簡単なぶん、データがどこへ流れているかを意識しないまま運用してしまいがちです。

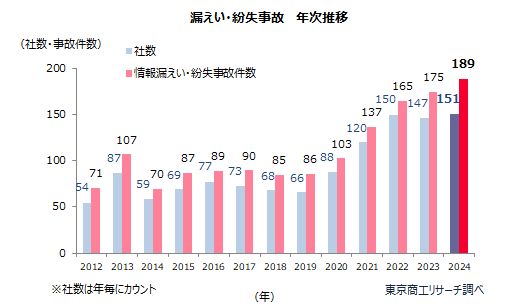

東京商工リサーチの調査によると、2024年に上場企業およびその子会社が公表した個人情報の漏洩・紛失事故は189件に達し、2012年の調査開始以来4年連続で過去最多を更新しました。漏洩した個人情報は約1,586万人分にのぼっています。

情報漏洩は大企業だけの問題ではありません。ワークフロー自動化を導入する中小企業においても、複数のクラウドサービスを連携させている以上、同様のリスクが存在します。

ワークフロー自動化におけるデータの流れを理解する

リスクを正しく把握するためには、まずワークフロー自動化でデータがどう動くかを理解する必要があります。ワークフローは基本的にトリガー、処理、アクションという3つのステップで構成されており、各ステップでデータが外部に出ていく構造になっています。

トリガーからアクションまでのデータ経路

具体例で見てみましょう。顧客がWebフォームに情報を入力すると、まずフォームサービスのサーバーにデータが保存されます。次に、ワークフローツール(n8nやZapierなど)がそのデータを受け取り、ツール自身のサーバーで処理します。最後に、処理結果がGoogle SheetsやCRMなどの連携先に送信され、そこでもデータが保存されます。

つまり、1つのワークフローが実行されるだけで、顧客データは最低でも3つ以上のサーバーを経由しています。フォームサービスのサーバー、ワークフローツールのサーバー、連携先サービスのサーバーです。それぞれのサーバーがどの国にあるか、どのような暗号化がされているかは、サービスごとに異なります。

外部サービスへのAPI連携で起きること

ワークフローツールと各サービスの間のデータ受け渡しは、API(Application Programming Interface)という仕組みで行われています。APIとは、あるサービスの機能やデータを別のサービスから利用するための窓口のようなものです。

API連携では、データを送受信するたびに相手先のサーバーにデータが渡されます。このとき重要なのは、データの安全性が連携先サービスのセキュリティポリシーに依存するという点です。自社がどれだけセキュリティ対策を施していても、連携先のサービスにセキュリティ上の問題があれば、そこからデータが漏洩する可能性があります。

また、APIを利用する際にはAPIキーやアクセストークンと呼ばれる認証情報が必要になります。これはサービスにアクセスするための合鍵のようなもので、この認証情報が漏洩すると、第三者がデータに不正アクセスできる状態になります。

ログや中間データが残る仕組み

見落としがちなポイントとして、ワークフローツールが実行履歴(ログ)を保存しているという事実があります。多くのワークフローツールでは、いつ、どのような処理が行われたかを記録するために、実行ログを一定期間保存しています。

この実行ログには、処理したデータの中身がそのまま含まれていることがあります。つまり、顧客の氏名やメールアドレス、電話番号といった個人情報がログとしてワークフローツールのサーバーに残り続ける可能性があるのです。

ワークフローを削除したり、連携を解除したりしても、実行ログが自動的に削除されるとは限りません。自分では処理が完了したと思っていても、ログの中にデータが残り続けているケースは珍しくありません。

ワークフロー自動化のデータ保護で知っておくべきリスク

ワークフロー自動化におけるデータ保護のリスクは、大きく3つのカテゴリに分けられます。

- 認証情報(APIキー・トークン)の漏洩

- 連携先サービスへのデータ預け先リスク

- ステップ間の中間データが意図せず残る問題

それぞれの具体的な内容を見ていきましょう。

認証情報(APIキー・トークン)の漏洩

APIキーやアクセストークンは、サービスにログインするための合鍵のようなものです。これが第三者の手に渡ると、あなたのアカウントを通じてデータにアクセスされたり、サービスを不正に利用されたりする危険性があります。

ハードコーディングの危険性

ハードコーディングとは、APIキーをワークフローの設定ファイルやスクリプトの中に直接書き込んでしまうことです。これは非常に危険な行為です。

たとえば、ワークフローの設定をチームメンバーと共有するためにエクスポートした場合、APIキーもそのまま一緒に出力されてしまいます。共有先のメンバーが意図せずその設定ファイルを外部に公開してしまうと、APIキーが世界中から閲覧可能な状態になります。

GitGuardianの調査によると、2023年にGitHub上で公開状態になっていた認証情報は1,280万件にのぼり、300万以上のリポジトリから検出されました。漏洩した認証情報の種別ではGoogle APIキーが最多で、MongoDB認証情報、クラウドサービスのキーなどが続いています。

さらに2025年には、セキュリティ企業Wizの調査で、Forbes誌のAI 50に選出された企業のうちGitHubを利用する企業の約65%から非公開のAPIキーが流出していたことが報告されています。AIを活用したコード生成(バイブコーディング)の普及が、認証情報の流出増加の一因として指摘されています。

ワークフロー自動化においても、設定ファイルの中にAPIキーを直接記述してしまう事例は少なくありません。特にノーコードツールでは設定のエクスポート機能が簡単に使えるため、認証情報が意図せず外部に出てしまうリスクを常に意識する必要があります。

共有アカウント運用で起きる事故

チームで1つのワークフローツールアカウントを共有し、1つのAPIキーを使い回す運用も大きなリスクです。

この運用方法では、誰がいつどの操作を行ったかを追跡できません。万が一データ漏洩が発生しても、原因の特定が困難になります。また、チームメンバーが退職した場合、そのメンバーがAPIキーの情報を控えていれば、退職後もデータにアクセスできる状態が続きます。

実際に、退職者が在籍時の管理者権限を利用し、退職後もファイルサーバーに不正アクセスしてデータを持ち出した事例が2025年に報告されています。ワークフロー自動化でも同様に、退職者のアクセス権限やAPIキーを放置していれば、同じことが起こりえます。

連携先サービスへのデータ預け先リスク

ワークフロー自動化では、Google Sheets、Slack、CRM、メール配信サービスなど、複数の外部サービスとデータを連携します。自社のセキュリティ対策がどれだけ堅固でも、連携先のサービスに脆弱性があれば、そこからデータが漏洩する可能性があります。

サービスごとに異なるデータ保持ポリシー

連携するサービスごとに、データの保存期間、保存場所、削除ポリシーは異なります。あるサービスでは30日でデータを自動削除するかもしれませんが、別のサービスではアカウントを解約するまでデータを保持し続けるかもしれません。

また、データがどの国のサーバーに保存されるかも重要なポイントです。日本国内のサーバーに保存されると思っていたデータが、実際には海外のデータセンターに保存されているケースもあります。後述する法規制との関連で、データの保存場所は法的な影響をもたらすことがあります。

自分のデータがどこの国のサーバーに保存されているか、いつ削除されるかを把握しているでしょうか。把握できていない場合は、連携先サービスのプライバシーポリシーやセキュリティページを確認することをおすすめします。

無料プランと有料プランのセキュリティ差

多くのSaaS(クラウド型のソフトウェアサービス)では、無料プランと有料プランでセキュリティ機能に差があります。無料プランでは、データの暗号化が限定的であったり、アクセス制御の細かい設定ができなかったり、監査ログが提供されなかったりすることがあります。

業務で顧客の個人情報を扱うワークフローを構築する場合、連携先サービスの無料プランで十分なセキュリティが確保できるかは慎重に検討すべきです。コストを抑えたい気持ちは理解できますが、セキュリティ上の問題が発生した場合の損害(信頼の失墜、損害賠償、業務停止など)を考えると、必要なセキュリティ機能が揃ったプランを選択する方が合理的です。

ステップ間の中間データが意図せず残る問題

ワークフローの各ステップでは、処理途中のデータが一時的に保存されることがあります。この中間データが意図せず残り続けることが、もう1つの重要なリスクです。

一時ファイルやキャッシュの扱い

ワークフローの中でファイル変換やデータ加工を行う場合、一時ファイルがツール側のサーバーに保存されることがあります。たとえば、顧客リストのCSVファイルをPDFに変換するワークフローでは、変換処理のために元のCSVファイルが一時的にワークフローツールのサーバーにアップロードされます。

変換が完了した後、この一時ファイルがすぐに削除されるかどうかはツールの仕様に依存します。削除されずにキャッシュとして残り続ける場合、顧客データを含むファイルがツールのサーバーに保存されたままになるリスクがあります。

エラー時のデータ残留

ワークフローが途中でエラーを起こして停止した場合、途中まで処理されたデータがそのまま残る問題もあります。たとえば、顧客データをCRMに送信するワークフローがCRM側のエラーで停止した場合、ワークフローツールのサーバーには送信予定だったデータがそのまま残ります。

さらに、エラーログにも注意が必要です。エラーの原因を特定するために、多くのツールがエラー発生時のデータ内容をログに記録します。このエラーログに個人情報が含まれるケースがあり、ログの保存期間や閲覧権限を適切に管理しなければ、情報漏洩のリスクとなります。

ワークフロー自動化のデータ保護を実現する具体的な対策

リスクを理解した上で、実務者が今日から実行できる対策は大きく4つあります。

- 認証情報の安全な管理

- 連携先サービスの適切な選定と設定

- 中間データとログの制御

- 法規制の基本の理解

それぞれ具体的に見ていきましょう。

認証情報を安全に管理する

APIキー漏洩のリスクに対する最も基本的な対策です。非エンジニアでもすぐに実行できる方法があります。

環境変数・シークレットマネージャーの活用

APIキーを設定ファイルやスクリプトに直接書き込むのではなく、ツールが提供する安全な認証情報管理機能を利用しましょう。

たとえばn8nにはCredentials(クレデンシャル)機能があり、APIキーやパスワードを暗号化して保存できます。Zapierでも同様に、接続管理の画面からサービスの認証情報を安全に保存する仕組みが用意されています。Makeにも同種のConnections機能があります。

これらの機能を使えば、ワークフローの設定をエクスポートしても認証情報は含まれません。チームでワークフローを共有する場合でも、各メンバーが自分のアカウントで認証情報を個別に設定する運用が可能になります。

より本格的な管理を行う場合は、シークレットマネージャーと呼ばれる専用の認証情報管理サービスを活用する方法もあります。AWS Secrets ManagerやHashiCorp Vaultなどが代表的ですが、まずはワークフローツールの標準機能を正しく使うことから始めるのが現実的です。

最小権限の原則でAPIキーを発行する

APIキーを発行する際は、そのワークフローに必要な最小限の権限だけを付与する考え方が重要です。これを最小権限の原則と呼びます。

たとえるなら、家全体の合鍵を渡すのではなく、必要な部屋だけの鍵を渡すようなものです。ワークフローがスプレッドシートにデータを書き込むだけなら、書き込み権限だけのAPIキーを発行します。読み取りや削除の権限まで含めた全権限のキーは不要です。

万が一APIキーが漏洩した場合でも、そのキーにできることが限定されていれば、被害の範囲を最小限に抑えられます。また、ワークフローごとに別々のAPIキーを発行しておけば、問題が発生したキーだけを無効化でき、他のワークフローへの影響を避けられます。

連携先サービスの選定と設定

連携先サービスのリスクに対しては、ツールを選ぶ段階と、選んだ後の設定段階の両方で対策が必要です。

データ保持期間・保存場所の確認方法

連携先サービスを選定する際、あるいは既に使っているサービスを見直す際には、以下の情報を確認しましょう。

まず、サービスのプライバシーポリシーやセキュリティページを開きます。多くのサービスでは、データの保存場所(リージョン)、保存期間、削除ポリシーをこれらのページで公開しています。英語のサービスの場合はSecurity、Privacy Policy、Data Processing Agreement(DPA)といったページを探してください。

確認すべきポイントは、データがどの国のサーバーに保存されるか、データの保持期間はどのくらいか、アカウント解約後にデータは完全に削除されるか、暗号化の方式は何かの4点です。

これらの情報が見つからない場合は、サービスのサポート窓口に直接問い合わせることも有効です。セキュリティに関する質問に回答できない、あるいは回答を拒否するサービスは、業務データを預ける先としては不安が残ります。

不要なデータ連携を削ぎ落とす設計

ワークフローを設計する段階で、本当にそのデータを連携先に渡す必要があるかを吟味することも重要な対策です。この考え方をデータミニマイゼーション(データの最小化)と呼びます。

たとえば、問い合わせ対応の状況をSlackに通知するワークフローを考えてみましょう。通知に必要な情報は問い合わせ番号とステータスだけであれば、顧客の氏名やメールアドレスをSlackに送信する必要はありません。

連携するデータの項目を最小限に絞ることで、仮に連携先サービスで問題が発生しても、漏洩する可能性のあるデータの範囲を大幅に縮小できます。ワークフロー構築時には、各ステップで渡すデータのうち本当に必要なフィールドだけを選択する習慣をつけましょう。

中間データとログの制御

ワークフローの実行過程で生成される中間データやログを適切に管理するための対策です。

機密データをログに出力しない設定

多くのワークフローツールでは、実行ログに含まれる情報の範囲を設定で調整できます。使っているツールのログ設定を確認し、機密データがログに含まれないように調整しましょう。

n8nの場合は、ワークフロー設定でLog Outputのレベルを調整したり、実行データの保存期間を設定したりできます。Zapierでは、Task Historyの保存期間がプランによって異なります。

ツールによって設定方法は異なりますが、共通して確認すべきポイントは、実行ログの保存期間はどのくらいか、ログに実データ(個人情報など)が含まれる設定になっていないか、ログの閲覧権限は適切に制限されているかの3点です。

自分が使っているワークフローツールのドキュメントで、ログ設定に関する項目を確認することをおすすめします。

ワークフロー完了後の一時データ削除

ワークフローの実行が完了した後、一時データが自動的に削除される設定になっているかを確認しましょう。ツールによっては、実行データの保持期間を設定できる機能があります。

たとえばn8nでは、実行データの保存に関する設定で、成功した実行のデータを保存するかどうか、保存する場合の期間をカスタマイズできます。不要な実行データは定期的に削除する設定にしておくことで、データが長期間サーバーに残り続けるリスクを軽減できます。

また、ファイルを扱うワークフローでは、処理完了後に一時ファイルを明示的に削除するステップをワークフローに組み込むことも有効な対策です。

法規制の基本を押さえる

ワークフロー自動化におけるデータ保護対策は、単にセキュリティのベストプラクティスとして推奨されるだけでなく、法律によって義務づけられている側面もあります。ここでは、実務者として最低限知っておくべき法規制の基本を簡潔に整理します。

個人情報保護法とワークフロー自動化の接点

日本の個人情報保護法では、個人情報を取り扱う事業者に対して、安全管理措置(データを安全に管理するための対策)を講じることが義務づけられています。ワークフロー自動化で外部のクラウドサービスに個人データを預ける場合、この安全管理措置の一環として、連携先サービスのセキュリティ対策を確認する必要があります。

特に重要なのは、クラウドサービスの利用が個人データの委託に該当するかどうかという論点です。2024年3月に個人情報保護委員会が公表した注意喚起では、クラウドサービス提供事業者が個人データにアクセスできる状態にある場合は、個人データの取扱いの委託に該当しうるとの判断が示されました。委託に該当する場合、利用企業は委託先のクラウドサービス事業者を監督する義務を負います。

ワークフロー自動化ツールを通じて個人データを外部サービスに連携する行為は、この委託に該当する可能性があります。個人データをどのサービスに預けているかを把握し、各サービスのセキュリティ対策が適切であることを確認しておくことが実務上求められます。

GDPRが日本企業に影響するケース

GDPR(EU一般データ保護規則)は、EU居住者の個人データを保護するための規制です。日本国内の企業であっても、EU圏に顧客がいる場合やEU居住者の個人データを扱う場合にはGDPRの適用対象となる可能性があります。

たとえば、ECサイトを運営していてEU圏からの注文を受け付けている場合や、EU拠点の取引先の担当者情報を管理している場合などが該当します。ワークフロー自動化でこれらのデータを外部サービスに連携する際には、GDPRが求めるデータ保護の基準を満たす必要があります。

GDPRは違反時の制裁金が高額になりうるため、該当する可能性がある場合は早めに法務担当者や専門家に相談することをおすすめします。

ワークフロー自動化ツール選定時のデータ保護チェックポイント

ワークフロー自動化ツールをこれから選ぶ方にも、既に使っているツールを見直したい方にも共通する、データ保護の観点で確認すべき3つのポイントがあります。

- データの保存場所とリージョン

- 第三者認証の有無

- 監査ログ・アクセス制御機能の充実度

これらは特定のツールの優劣を比較するためではなく、どのツールを評価する場合にも使える判断軸です。

データの保存場所とリージョン

ワークフローツールがデータをどの国・地域のサーバーに保存するかは、セキュリティと法規制の両面で重要です。

日本国内にデータを保存できるツールであれば、日本の法律の範囲内でデータが管理されるため、法的なリスクが比較的明確です。海外のサーバーに保存される場合は、その国のデータ保護法制や、日本の個人情報保護法における外国への第三者提供に関する規定を考慮する必要があります。

ツールの公式サイトでSecurity、Data Residency、Infrastructureなどのページを確認すれば、データセンターの所在地が記載されていることが多いです。n8nのようにセルフホスト(自社のサーバーにインストールして運用)が可能なツールであれば、データの保存場所を完全に自社でコントロールできる利点があります。

第三者認証(SOC 2・ISO 27001)の有無

SOC 2やISO 27001は、情報セキュリティに関する国際的な認証規格です。これらの認証を取得しているサービスは、第三者の監査機関によってセキュリティ対策が一定の基準を満たしていることが確認されています。

SOC 2は、データのセキュリティ、可用性、処理の完全性、機密性、プライバシーの5つの原則に基づく評価です。ISO 27001は、情報セキュリティマネジメントシステム(ISMS)に関する国際規格です。

これらの認証があれば絶対に安全というわけではありませんが、サービス提供者がセキュリティに対して組織的に取り組んでいることの客観的な証拠になります。ツール選定時には、公式サイトのSecurityページやTrust Centerで認証の取得状況を確認しましょう。

監査ログ・アクセス制御機能の充実度

誰がいつ何を操作したかを記録する監査ログ機能と、チームメンバーごとにアクセス権限を細かく設定できるアクセス制御機能は、データ保護の観点から非常に重要です。

監査ログがあれば、万が一インシデントが発生した際に原因を特定しやすくなります。また、アクセス制御により、ワークフローの閲覧や編集の権限を必要なメンバーだけに限定することで、内部からの情報漏洩リスクを低減できます。

無料プランでは監査ログやアクセス制御が利用できないツールも多いため、業務で本格的に運用する場合は有料プランの機能を確認しておくことが大切です。

ワークフロー自動化×データ保護の実践チェックリスト

ここまでの内容を、導入前と運用開始後の2つのフェーズに分けたチェックリストとして整理します。印刷やブックマークしておくと、実際にワークフロー自動化を進める際の確認に使えます。

導入前に確認すべき項目

ワークフロー自動化を始める前に、以下の準備をしておくことで、あとから問題が発覚して手戻りが発生するリスクを大幅に減らせます。

自動化対象業務のデータ棚卸し

まず、自動化しようとしている業務でどんなデータが流れるかをリストアップしましょう。何のデータを、どこから取得し、どこへ渡すのかを明確にします。

たとえば、問い合わせ対応を自動化する場合は以下のように整理します。取得元はWebフォーム、含まれるデータは氏名、メールアドレス、問い合わせ内容、送信先はGoogle Sheets、Slack、CRM、というように具体的に書き出します。

この作業を行うことで、どのサービスにどんなデータを預けることになるかが可視化され、次のステップであるリスク評価が行いやすくなります。

取り扱うデータの分類とリスク評価

棚卸ししたデータを、その性質に応じて分類します。個人情報(氏名、メールアドレス、電話番号など)、社内機密情報(売上データ、契約内容など)、公開情報(商品情報、公開済みコンテンツなど)といったカテゴリに分けましょう。

すべてのデータを同じレベルで保護する必要はありません。個人情報や社内機密情報はより厳格な管理が求められますが、公開情報であればリスクは限定的です。分類することで、どのワークフローに優先的にセキュリティ対策を施すべきかの判断ができるようになります。

社内承認フローの整備

新しいワークフローツールの導入や外部サービスとの連携を開始する前に、上長やIT部門の承認を得るフローを整備しておきましょう。個人の判断だけで顧客データを外部サービスに連携してしまうと、あとから社内でトラブルになりかねません。

承認フローを設けることは、セキュリティ対策であると同時に、組織としてのリスク管理でもあります。この記事のチェックリスト部分を上長に共有し、データ保護の必要性を説明する材料として活用していただくのも1つの方法です。

運用開始後に継続すべき項目

ワークフロー自動化のデータ保護は、導入時に対策すれば終わりではありません。継続的に見直すことで、セキュリティを維持できます。

定期的なアクセス権限と認証情報の棚卸し

四半期(3ヶ月)に1回を目安に、以下の点を確認しましょう。退職したメンバーのアクセス権限が残っていないか、使用していないAPIキーやトークンがないか、各ワークフローに設定されている権限は適切か、連携を解除したサービスにデータが残っていないかの4点です。

退職者のアカウントが残ったまま放置されるケースは非常に多く、不正アクセスの原因になります。定期的な棚卸しをカレンダーに登録し、忘れずに実行する仕組みを作りましょう。

インシデント発生時の対応フロー策定

データ漏洩や不正アクセスが発生した場合に、誰が、何を、どの順番で実行するかを事前に決めておくことが重要です。大企業のようなセキュリティ専門チーム(CSIRT)を置く必要はありませんが、最低限、連絡先リストと手順書は準備しておきましょう。

具体的には、異常を発見した場合の連絡先(IT担当者、上長、必要に応じて外部のセキュリティベンダー)、ワークフローの一時停止手順、影響範囲の特定方法(どのデータがどのサービスにあるかの一覧を準備しておく)、個人情報保護委員会への報告が必要かどうかの判断基準の4つを文書化しておくと、いざというときに慌てずに対応できます。

個人情報保護法では、一定の基準に該当する個人データの漏洩が発生した場合、個人情報保護委員会への報告と本人への通知が義務づけられています。この報告は発覚後速やかに(速報は概ね3〜5日以内、確報は30日以内)行う必要があるため、事前にフローを決めておかないと対応が遅れるリスクがあります。

ツールのアップデート・仕様変更への追従

ワークフローツールや連携先サービスは、頻繁にアップデートされます。セキュリティ機能の改善が含まれることもあれば、逆にアップデートによって従来のセキュリティ設定がリセットされたり、デフォルトの動作が変わったりすることもあります。

各ツールのリリースノートやアップデート通知を定期的に確認する習慣をつけましょう。メール通知やRSSフィードを設定しておくと、重要な変更を見逃しにくくなります。特にセキュリティに関するアップデートは優先的に対応することが大切です。

まとめ

ワークフロー自動化は業務効率を大きく向上させますが、データを複数の外部サービスに預ける以上、データ保護の対策は不可欠です。認証情報の安全な管理、連携先サービスの適切な選定と設定、中間データ・ログの制御、そして法規制の基本理解という4つの対策を押さえることで、安全にワークフロー自動化を運用できます。導入前にはデータの棚卸しと分類、社内承認フローの整備を行い、運用開始後はアクセス権限の定期的な見直しとインシデント対応フローの策定を継続しましょう。この記事のチェックリストを活用して、安心してワークフロー自動化を始めてください。